对于行业而言,这意味着AI落地的速度将大幅加快,应用场景将持续拓宽;而对于竞争对手而言,如何突破英伟达的生态壁垒,将成为未来几年的核心命题。

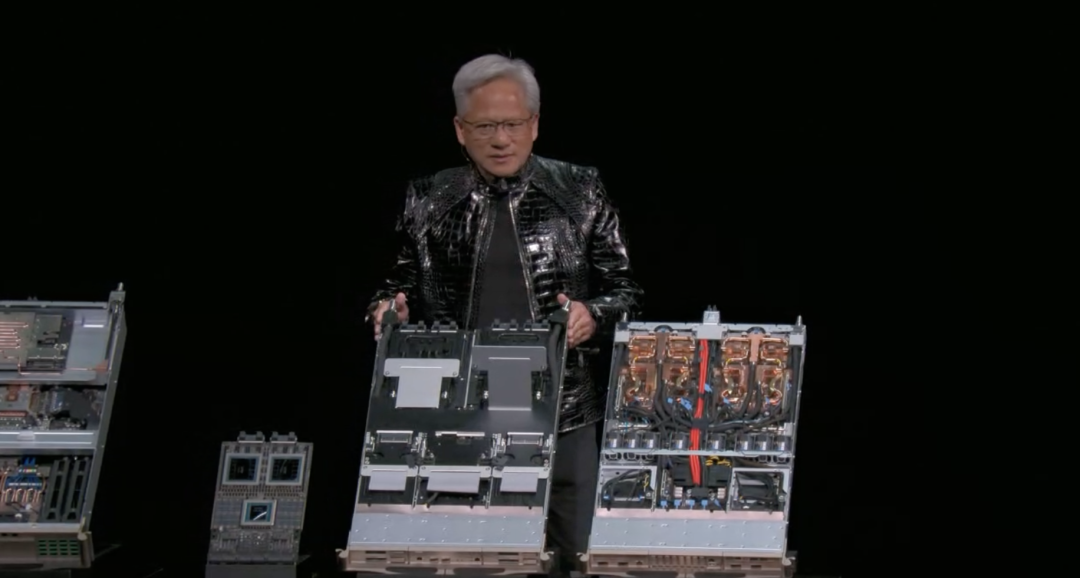

当地时间2026年1月5日,拉斯维加斯CES展会的舞台上,黄仁勋依旧身着标志性黑色夹克,带来了一场颠覆行业认知的主题演讲。没有延续五年的新GPU发布惯例,却用Rubin超级计算平台的量产落地、物理AI的生态布局,清晰勾勒出AI产业的下一代进化蓝图。这场演讲的核心洞见远超产品发布本身——AI已正式告别单纯的数字生成时代,迈入智能体(Agentic)与物理智能深度融合的新纪元,而英伟达正通过全栈生态构建,试图成为这场变革的绝对规则制定者。

黄仁勋在演讲中反复强调:“Agentic AI 将成为多万亿美元级市场。”这一判断并非空穴来风,而是基于AI技术从辅助工具到自主决策者的根本性跨越。

如果说前几年的生成式AI实现了“让AI会创造”,那么Agentic AI则致力于“让AI会行动”——通过基础模型与推理系统的协同,AI能够理解复杂环境、自主规划任务路径、闭环执行操作,最终嵌入产业自动化与生活服务的各个场景。2025年已被公认为AI Agent商业元年,普华永道数据显示79%的组织已开始采用相关技术,Salesforce报告则显示AI Agent的创建部署量年增长超119%,这些数据印证了黄仁勋对市场规模的精准预判。

Agentic AI的落地,离不开对现实世界的感知与交互,这正是英伟达“物理AI”战略的核心逻辑。与生成AI聚焦数字内容创作不同,物理AI将价值锚点放在了机器人、自动驾驶等实体场景,强调AI不仅能“思考”,更能在物理空间中“行动”。

黄仁勋在演讲中详解了这一战略的两大支柱:一方面,通过Cosmos世界基础模型平台提供物理语境下的训练数据与模拟环境,让AI在虚拟空间中完成千万次场景演练后再落地实体;另一方面,推出全球首个开源自动驾驶推理模型Alpamayo,将梅赛德斯奔驰CLA作为首款落地车型,计划2026年逐步进入全球主流市场。这种“仿真训练+实体部署”的模式,正在破解长期困扰AI落地的现实适配难题,而西门子将CUDA-X库集成至机器人仿真工作流的合作,更凸显了物理AI在工业领域的巨大潜力。

支撑这一系列战略落地的核心,是英伟达全新发布的Rubin超级计算平台。作为下一代AI计算基座,Rubin平台的技术突破直指AI规模化应用的核心痛点:成本与效率。

该平台集成Vera CPU与Rubin GPU,性能达到上一代Grace Blackwell的两倍,却将组装时间从2小时压缩至5分钟,且无需水冷设备即可满足散热需求。其中Rubin GPU搭载第三代Transformer引擎,NVFP4精度下推理算力达50PFLOPS,是Blackwell的5倍;而完整的Vera Rubin NVL144 CPX平台更是实现单机架8 exaflops的AI性能,相当于上一代系统的7.5倍。

更具革命性的是其分离式推理架构,将计算拆分为“上下文理解”与“内容生成”两个阶段,配合128GB GDDR7内存与每秒1.7千万亿字节的内存带宽,可支持百万级token的上下文处理——这意味着AI能一次性解析1小时高清视频或百万行代码,为复杂任务处理提供了前所未有的效率支撑。

黄仁勋直言:“在这些新系统上投资1亿美元可以帮助产生50亿美元的象征性收入”,这种30至50倍的投资回报率,正是Rubin平台撬动产业变革的关键底气。

如果说Rubin平台是物理AI时代的“算力发动机”,那么英伟达构建的全栈生态则是其掌控行业话语权的“操作系统”。黄仁勋深知,AI竞争早已超越单一芯片的算力比拼,进入“硬件-软件-工具链-开发者”的生态竞争阶段。为此,英伟达采取了开源与自研并行的生态扩张策略:不仅开源了Cosmos、Llama Nemotron等模型平台,更将自动驾驶模型Alpamayo免费开放,同时持续迭代CUDA-X加速库、Omniverse模拟平台等核心工具。

这种布局让英伟达跳出了“芯片供应商”的身份局限,成为AI产业的“基础设施服务商”——开发者在其生态中可获得从模型训练、仿真测试到实体部署的全流程支持,企业则能通过生态协同快速降低AI落地成本。黄仁勋在演讲中强调:“我们不仅开源模型,还会开源训练数据,让你真正相信这些模型如何成形”,这种开放姿态背后,是构建行业标准的深层战略意图。

值得注意的是,英伟达的全栈生态布局,正值AI产业竞争格局重塑的关键节点。2025年以来,谷歌TPU、亚马逊Trainium 3等ASIC芯片崛起,AMD凭借MI350系列与OpenAI达成百亿级合作,国产芯片也在加速替代进程,英伟达的GPU霸权面临多方挑战。但黄仁勋的应对策略并非单纯比拼硬件参数,而是通过生态捆绑巩固竞争壁垒——目前CUDA生态已成为高性能计算领域的事实标准,而Rubin平台的分离式架构、百万级token处理能力,进一步强化了生态的技术壁垒。

更重要的是,英伟达通过百亿美元投资Anthropic、千亿美元级入股OpenAI等动作,将核心客户转化为生态合作伙伴,形成“芯片-模型-应用”的闭环协同。这种竞争策略的转变,让AI产业的竞争从“产品之争”升级为“生态之争”,而英伟达显然已占据先发优势。

从行业演进的视角看,黄仁勋在CES 2026的演讲,标志着AI产业进入“智能体+物理世界”的深度融合阶段。这一阶段的核心特征是:AI不再局限于数字空间的内容生成,而是通过多模态感知、自主决策能力,成为改造物理世界的核心生产力。

在自动驾驶领域,英伟达的DRIVE平台与AGX Thor芯片已实现从感知到决策的全栈支持,首款落地车型的上路将开启物理AI的规模化应用;在机器人领域,Omniverse的仿真能力与Cosmos的训练数据相结合,正在破解具身智能的落地难题;在工业领域,西门子与英伟达的合作则让AI从设计环节贯穿至生产执行,推动智能制造进入新阶段。这些应用场景的落地,印证了黄仁勋的判断:AI的下一波价值爆发,将来自于与物理世界的深度交互。

但英伟达的生态霸权并非无懈可击。随着多模态交互成为AI Agent的核心能力,语音、视觉等感知技术的迭代速度将影响生态的竞争力;而地缘政治因素导致的市场分化,也让其在中国等关键市场面临国产替代的压力。此外,开源生态的扩张也可能引发“反哺”效应——Deepseek-R1等开源模型的崛起已证明,开源社区的创新活力可能超出企业掌控。黄仁勋在演讲中承认“开源模型已经比大型AI公司的前沿闭源模型领先了六个月”,这一判断既体现了对行业趋势的清醒认知,也暗示了生态竞争的不确定性。

不过,从短期来看,英伟达的全栈优势仍难以撼动。Rubin平台的量产落地为其提供了硬件支撑,开源策略持续吸引全球开发者加入,而物理AI的先发布局则抢占了下一代AI的核心赛道。黄仁勋在演讲中描绘的愿景——“未来每一辆汽车、每一辆卡车都将实现自动驾驶”,正在通过具体的产品落地逐步成为现实。更重要的是,他通过这场演讲传递了明确的行业信号:AI产业的竞争规则已被重新定义,唯有掌握全栈生态能力、能支撑AI从“思考”到“行动”的企业,才能在万亿美元级市场中占据核心位置。

CES 2026的舞台上,黄仁勋没有用新GPU制造噱头,却用Rubin平台、物理AI生态和全栈战略,展现了英伟达的长期野心。

这场演讲不仅是对AI未来趋势的精准预判,更是一次行业话语权的宣示:当AI从数字空间走向物理世界,从辅助工具升级为智能体,英伟达正试图通过“算力基座+生态系统”的双重布局,成为这场革命的领航者。

对于行业而言,这意味着AI落地的速度将大幅加快,应用场景将持续拓宽;而对于竞争对手而言,如何突破英伟达的生态壁垒,将成为未来几年的核心命题。黄仁勋的演讲落幕,但AI产业的“物理智能时代”才刚刚开启,而这场变革的游戏规则,正被英伟达重新书写。

加载中,请稍侯......

加载中,请稍侯......